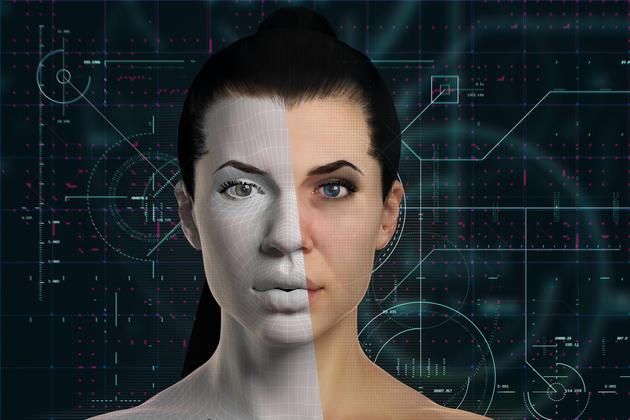

Zneužité fotografie žen. Deepfakes otevírá debatu o souhlasu a etice. Legislativa však tápe

Rozšiřující se využití technologií založených na strojovém učení a umělé inteligenci je zdrojem mnoha obav, z nichž některé nejsou až tak na místě. Strach ze zmanipulování syntetických médií neboli deepfakes je ale pochopitelný. Představa, že se můžete ocitnout v kompromitujících situacích, v nichž jste ve skutečnosti nikdy nebyli, je právem děsivá. Dosud byly takto zneužívány zejména ženy, bez jejichž vědomí byly části jejich těla využity ve filmové produkci pro dospělé. Jak to ale s deepfakes doopravdy je? Máme se čeho bát?

Samotné slovo deepfake, se kterým se dnes operuje zcela běžně, byla původně přezdívka anonymního uživatele na platformě Reddit, který přispíval silně manipulovanými videi převážně ženských celebrit v pornografických scénářích. Technologie manipulovaného videa, kterou dnes označujeme jako deepfakes, byla tedy téměř od počátku svého veřejného využití spojená právě s nekonsenzuální pornografií.

Začátkem letošního roku se tato problematika opět objevila v popředí zájmu. Streamerka s přezdívkou Sweet Anita objevila celou řadu pornografického obsahu, ve kterém se objevovala její deepfake verze, aniž by k tomu dala souhlas. Sama tuto zkušenost v rozhovoru pro CNN v únoru přirovnala k tomu, jako by se dívala na svou vlastní vraždu. Tato šokující situace poukazuje na širší problém: je využití deepfakes technologií „prostou“ otázkou výslovného svolení a jsou deepfakes jen další z řady nepochopených a zneužitých vynálezů? Je na místě laciná obžaloba, nebo je situace složitější?

Avatar dokáže hlásit zprávy nonstop

U základů moderních deepfakes stáli výzkumníci Christoph Bregler, Michele Covell a Malcolm Slaney, kteří v roce 1997 představili program s názvem Video Rewrite, tedy něco jako přepis videa. Program umožnil upravit video tak, aby jeho aktér vypadal, jako by říkal slova, která v originále neříkal. Tento program by podle tvůrců mohl najít využití například v dabingu. Na něj navázala celá řada dalších výzkumů, které technologii ještě zdokonalily a posunuly ke zcela jiným využitím. Zásadního zlomu se deepfakes technologie dočkala vznikem takzvaných generativních kompetitivních sítí. Takové sítě zjednodušeně fungují na principu odhalování vlastních nedokonalostí, ze kterých se mohou poučit.

Pokud jste se s termínem deepfakes už setkali, a dokonce v kontextu zneužití, pak to patrně bylo v souvislosti s politickou komunikací nebo s projevy státníků. Deepfakes se v této oblasti pohybují od komických videí tančících politiků až po jednoznačně škodlivé audiovizuální produkty vytvořené s cílem poškodit politické nebo názorové oponenty.

Mezi produkty deepfakes se ale řadí i umělí lidé, avataři, kteří nemají za úkol nikoho napodobit. Naopak mají působit jako prázdná schránka pro jakékoli informace, které se jim šiřitel rozhodne vložit do úst. Využití avatarů můžeme sledovat v současné době ve Venezuele. Jmenují se Noah a Daren a figurují jako reportéři státní televize VTV. Jejich autorem je londýnská společnost Synthesia, která se na AI produkty specializuje a která na svých stránkách nabízí hned několik avatarů k rozmanitému využití.

Dalí mluví i po smrti

Určitě by ale nebylo fér považovat deepfakes za strůjce informační apokalypsy nebo eroze demokracie. Stejně tak by nebylo fér dospět k unáhlenému závěru, že skutečně neexistuje žádný příklad pozitivního využití této technologie, jakkoli nemůžeme vyčítat některým lidem, že u nich k takové zkratce dojde. Není to tak. Deepfakes nachází své místo v celé řadě uměleckých projektů nebo jako nástroj performancí se zřetelným přesahem do společenských komentářů.

V roce 2019 představilo The Dalí Museum na Floridě Dalího deepfake avatara, který umožňuje návštěvníkům interagovat nejen s uměleckými díly, ale i s umělcem samotným. Dalším příkladem je práce konceptuální umělkyně Gillian Wearing, která se ve svých dílech zaměřuje na témata osobní identity a výsostně lidských prožitků. Ve svém krátkém filmu Wearing Gillian (přesmyčka jména, kterou lze také chápat jako „nosím Gillian“) pracuje s digitálními technologiemi tak, aby svůj obraz kombinovala s postavami herců a hereček, které hrají ji samotnou. Pomocí tohoto metazážitku sleduje, jaké to je, být sebou samou.

Jde to s deepfakes eticky?

Je však třeba si položit otázku, zda je využití deepfakes technologií otázkou výslovného svolení. Na osobní úrovni ano. Pakliže se podaří legislativě držet krok s neustále se vyvíjejícím trhem digitálních technologií založených na umělé inteligenci, pak bychom se mohli dočkat toho, že by se k deepfakes pornografii vytvořené bez svolení účinkujících přistupovalo jako k trestnému činu. Takové řešení je už několik let diskutováno ve Velké Británii, kde bude šíření nekonsenzuálního deepfake pornografického obsahu patrně kriminalizováno v revidovaném zákonu s názvem Online Safety Bill. Problematika nekonsenzuální pornografie samozřejmě otevírá dveře témuž obsahu v jeho konsenzuální podobě. S trochou nadsázky se dá říci, že tato oblast je žalostně neprobádaným teritoriem.

Na překvapivě obdobné rozuzlení narážím i v případě politické komunikace. Prostor k využití syntetických médií je nesmírně široký a i tady se jedná o otázku explicitního svolení nebo přiznání použité technologie. I zmiňovaní digitální televizní moderátoři jistě mohou najít využití za předpokladu, že nebudou vydávání za skutečné osoby, ale za to, co jsou.

Na deepfakes obsahu je zajímavé, že jak jeho výroba, tak konzumace je v první řadě otázkou etiky. To nejlepší, co pro sebe tedy můžeme udělat, je nastavit si osobní vztah s technologiemi tak, abychom si vždy a za všech okolností uvědomovali, co konzumujeme a zda to vzniklo eticky.

Jak si deepfakes nepustit k tělu

Otázka etiky a AI technologií je úzce spjata s diskuzí kolem algoritmů sociálních sítí, doporučovacích systémů, syntetických hlasů a filtrů, což jsou témata, která stojí zato mít na paměti při konzumaci online obsahu. U deepfakes obsahu je o něco snazší udělat si názor na důvod, proč vznikl. Pakliže je v novinářské praxi nebo politické komunikaci tato technologie přiznaná, je na každém z nás, abychom obsah přijímali s rezervou. Ani zde ale legislativa nesmí zůstat pozadu. Pakliže je dnes již běžnou praxí na některých sociálních sítích například zřetelně označovat reklamu, měla by přinejmenším stejně přísná pravidla platit i pro syntetická média.

Další rovinou je otázka, zda jsou deepfakes jen další z řady nepochopených a zneužitých vynálezů. Nejsou. Potenciál deepfakes technologií a syntetických médií byl odhalen velmi záhy po jejich uvedení do provozu. Proto se s nimi máme dnes možnost setkávat v podobě filtrů na sociálních sítích, ve filmovém průmyslu, ale bohužel i v případech uvedených výše.

V závěru je třeba odpovědět na otázku, zda se máme v případě deepfakes čeho bát. Z podstaty věci si nemyslím, že technologie založené na strojovém učení a umělé inteligenci by měly vyvolávat strach. Obezřetnost snad. Nebojím se malířských štětců, ale vždy je malá šance, že mi ho někdo schválně nebo jen z nepozornosti bodne do oka. Stejně jako v jiných oblastech i zde platí, že strojové učení a umělá inteligence jsou vždy jen nástrojem. Při jakékoli interakci s umělou inteligencí, ať už se jedná o textové generátory, audiovizuální generátory, nebo třeba syntetická média, je třeba přistupovat k materiálu s vědomím toho, že za ním v první a poslední řadě stojí vždy člověk.